Debido a que los grandes modelos de lenguaje operan utilizando estructuras similares a neuronas que pueden vincular muchos conceptos y modalidades diferentes, puede resultar difícil para los desarrolladores de IA ajustar sus modelos para cambiar su comportamiento. Si no sabes qué neuronas conectan qué conceptos, no sabrás qué neuronas cambiar.

El 21 de mayo, Anthropic creó un mapa notablemente detallado del funcionamiento interno de la versión perfeccionada de su modelo Claude 3 Sonnet 3.0. Con este mapa, los investigadores pueden explorar cómo los puntos de datos similares a neuronas, llamados características, afectan la salida de una IA generativa. De lo contrario, las personas sólo podrán ver el resultado en sí.

Algunas de estas características son “relevantes para la seguridad”, lo que significa que si las personas identifican esas características de manera confiable, podría ayudar a ajustar la IA generativa para evitar temas o acciones potencialmente peligrosas. Las características son útiles para ajustar la clasificación y la clasificación podría afectar el sesgo.

¿Qué descubrió Anthropic?

Los investigadores de Anthropic extrajeron características interpretables de Claude 3, un modelo de lenguaje grande de la generación actual. Las características interpretables se pueden traducir en conceptos comprensibles para los humanos a partir de los números legibles por el modelo.

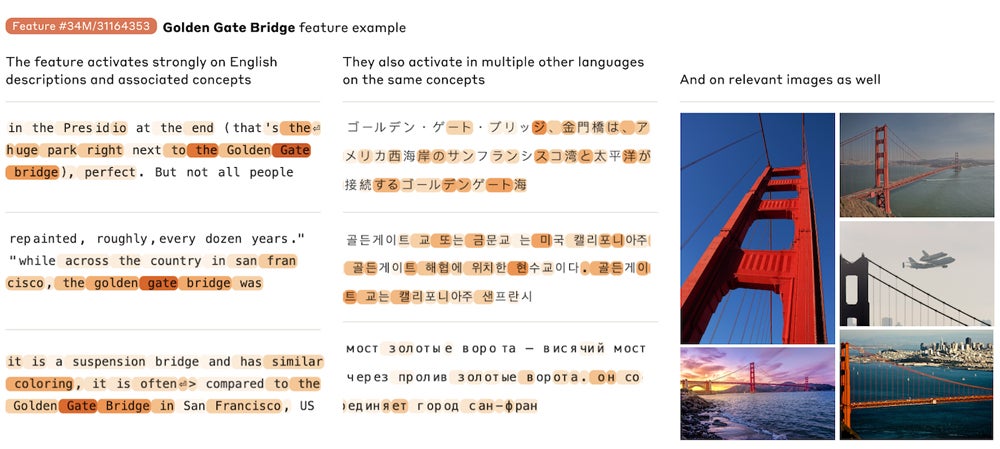

Las características interpretables pueden aplicarse al mismo concepto en diferentes idiomas y tanto a imágenes como a texto.

“Nuestro objetivo de alto nivel en este trabajo es descomponer las activaciones de un modelo (Claude 3 Sonnet) en piezas más interpretables”, escribieron los investigadores.

“Una esperanza de interpretabilidad es que pueda ser una especie de ‘conjunto de pruebas de seguridad, que nos permita saber si los modelos que parecen seguros durante el entrenamiento serán realmente seguros en el despliegue'”, dijeron.

VER: El plan empresarial Claude Team de Anthropic incluye un asistente de inteligencia artificial para pequeñas y medianas empresas.

Las características son producidas por codificadores automáticos dispersos, que son algoritmos. Durante el proceso de entrenamiento de la IA, los escasos codificadores automáticos se guían, entre otras cosas, por leyes de escala. Por lo tanto, identificar características puede dar a los investigadores una visión de las reglas que rigen los temas que asocia la IA. En pocas palabras, Anthropic utilizó escasos codificadores automáticos para revelar y analizar características.

“Encontramos una diversidad de características muy abstractas”, escribieron los investigadores. “Ellos (las características) responden y causan comportamientos abstractos”.

Los detalles de las hipótesis utilizadas para tratar de descubrir qué sucede bajo el capó de los LLM se pueden encontrar en el artículo de investigación de Anthropic.

Cómo la manipulación de funciones afecta el sesgo y la ciberseguridad

Anthropic encontró tres características distintas que podrían ser relevantes para la ciberseguridad: código inseguro, errores de código y puertas traseras. Estas funciones pueden activarse en conversaciones que no involucran código inseguro; por ejemplo, la función de puerta trasera se activa para conversaciones o imágenes sobre “cámaras ocultas” y “joyas con una unidad USB oculta”. Pero Anthropic pudo experimentar con la “sujeción” (en pocas palabras, aumentar o disminuir la intensidad de) estas características específicas, lo que podría ayudar a ajustar los modelos para evitar o manejar con tacto temas de seguridad delicados.

El sesgo o el discurso de odio de Claude se pueden ajustar mediante la sujeción de características, pero Claude se resistirá a algunas de sus propias declaraciones. Los investigadores de Anthropic “encontraron esta respuesta desconcertante”, antropomorfizando el modelo cuando Claude expresó “autodesprecio”. Por ejemplo, Claude podría generar “Eso es solo un discurso de odio racista de un robot deplorable…” cuando los investigadores limitaron una característica relacionada con el odio y los insultos a 20 veces su valor máximo de activación.

Otra característica que examinaron los investigadores es la adulación; podían ajustar el modelo para que elogiara exageradamente a la persona que conversaba con él.

¿Qué significa la investigación de Anthropic para las empresas?

Identificar algunas de las características utilizadas por un LLM para conectar conceptos podría ayudar a ajustar una IA para evitar discursos sesgados o para prevenir o solucionar casos en los que se podría hacer que la IA mienta al usuario. Una mayor comprensión de Anthropic de por qué el LLM se comporta de la manera en que lo hace podría permitir mayores opciones de ajuste para los clientes comerciales de Anthropic.

VER: 8 tendencias empresariales de IA, según investigadores de Stanford

Anthropic planea utilizar parte de esta investigación para profundizar en temas relacionados con la seguridad de la IA generativa y los LLM en general, como explorar qué funciones se activan o permanecen inactivas si a Claude se le pide que dé consejos sobre la producción de armas.

Otro tema que Anthropic planea abordar en el futuro es la pregunta: “¿Podemos utilizar la base de características para detectar cuándo el ajuste fino de un modelo aumenta la probabilidad de comportamientos indeseables?”

TechRepublic se ha comunicado con Anthropic para obtener más información.