AI Overviews, la próxima evolución de Search Generative Experience, se lanzará en los EE. UU. esta semana y pronto en más países, anunció Google en el Shoreline Amphitheatre de Mountain View, CA. Google mostró varios otros cambios que llegarán a Google Cloud, Gemini, Workspace y más, incluidas acciones de IA y resúmenes que pueden funcionar en todas las aplicaciones, lo que abre algunas opciones interesantes para las pequeñas empresas.

La búsqueda incluirá descripciones generales de IA

AI Overviews es la expansión de la experiencia generativa de búsqueda de Google, las respuestas generadas por IA que aparecen en la parte superior de las búsquedas de Google. Es posible que ya haya visto SGE en acción, ya que usuarios selectos de EE. UU. pudieron probarlo desde octubre pasado. SGE puede generar imágenes o texto. AI Overviews agrega información generada por IA en la parte superior de los resultados de cualquier motor de búsqueda de Google.

Con AI Overviews, “Google hace el trabajo por usted. En lugar de reunir toda la información usted mismo, puede hacer sus preguntas y “obtener una respuesta al instante”, dijo Liz Reid, vicepresidenta de Búsqueda de Google.

Para finales de año, AI Overviews llegará a más de mil millones de personas, dijo Reid. Google quiere poder responder “diez preguntas en una”, vinculando tareas para que la IA pueda establecer conexiones precisas entre la información. Esto es posible mediante un razonamiento de varios pasos. Por ejemplo, alguien podría preguntar no sólo por los mejores estudios de yoga de la zona, sino también por la distancia entre los estudios y su casa y las ofertas de lanzamiento de los estudios. Toda esta información aparecerá en columnas convenientes en la parte superior de los resultados de la búsqueda.

Pronto, AI Overviews también podrá responder preguntas sobre los videos que se le proporcionen.

AI Overviews se implementará en “las próximas semanas” en los EE. UU. y estará disponible primero en Search Labs.

¿Las descripciones generales de IA realmente hacen que la Búsqueda de Google sea más útil? Google dice que observará cuidadosamente qué imágenes son generadas por IA y cuáles provienen de la web, pero las descripciones generales de IA pueden diluir la utilidad de la búsqueda si las respuestas de la IA resultan incorrectas, irrelevantes o engañosas.

Gemini 1.5 Pro recibe algunas actualizaciones, incluida una ventana de contexto de 2 millones para usuarios seleccionados

El modelo de lenguaje grande de Google, Gemini 1.5 Pro, está recibiendo mejoras de calidad y una nueva versión, Gemini 1.5 Flash. Las nuevas funciones para desarrolladores en la API de Gemini incluyen extracción de fotogramas de vídeo, llamada a funciones paralelas y almacenamiento en caché de contexto para desarrolladores. La extracción de fotogramas de vídeo nativos y la llamada a funciones paralelas ya están disponibles. Se espera que el almacenamiento en caché de contexto disminuya en junio.

Disponible hoy a nivel mundial, Gemini 1.5 Flash es un modelo más pequeño enfocado en responder rápidamente. Los usuarios de Gemini 1.5 Pro y Gemini 1.5 podrán ingresar información para que la IA la analice en una ventana de 1 millón de contexto.

Además de eso, Google está ampliando la ventana contextual de Gemini 1.5 Pro a 2 millones para clientes selectos de Google Cloud. Para obtener una ventana de contexto más amplia, únase a la lista de espera en Google AI Studio o Vertex AI.

El objetivo final es un “contexto infinito”, dijo el director ejecutivo de Google, Sundar Pichai.

Gemma 2 viene en un tamaño de parámetro 27B

El modelo de lenguaje pequeño de Google, Gemma, recibirá una importante revisión en junio. Gemma 2 tendrá un modelo de parámetros 27B, en respuesta a que los desarrolladores solicitaron un modelo Gemma más grande que aún sea lo suficientemente pequeño como para caber dentro de proyectos compactos. Gemma 2 puede ejecutarse de manera eficiente en un único host TPU en Vertex AI, dijo Google. Gemma 2 estará disponible en junio.

Además, Google lanzó PaliGemma, un modelo de lenguaje y visión para tareas como subtítulos de imágenes y hacer preguntas basadas en imágenes. PaliGemma ya está disponible en Vertex AI.

El resumen de Gemini y otras funciones se adjuntarán a Google Workspace

Google Workspace está recibiendo varias mejoras de IA, que están habilitadas por la ventana de contexto larga y la multimodalidad de Gemini 1.5. Por ejemplo, los usuarios pueden pedirle a Gemini que resuma largos hilos de correo electrónico o llamadas de Google Meet. Gemini estará disponible en el panel lateral de Workspace el próximo mes en computadoras de escritorio para empresas y consumidores que usan los complementos Gemini for Workspace y el plan Google One AI Premium. El panel lateral de Gemini ahora está disponible en Workspace Labs y para usuarios de Gemini for Workspace Alpha.

Los clientes de Workspace y AI Advanced podrán utilizar algunas funciones nuevas de Gemini en el futuro, que comenzarán para los usuarios de Labs este mes y estarán disponibles de forma general en julio:

- Resumir los hilos de correo electrónico.

- Ejecute una sesión de preguntas y respuestas en la bandeja de entrada de su correo electrónico.

- Utilice respuestas sugeridas más largas en Respuesta inteligente para extraer información contextual de los hilos de correo electrónico.

Gemini 1.5 puede establecer conexiones entre aplicaciones en Workspace, como Gmail y Docs. El vicepresidente y director general de Workspace de Google, Aparna Pappu, lo demostró mostrando cómo los propietarios de pequeñas empresas podrían utilizar Gemini 1.5 para organizar y realizar un seguimiento de sus recibos de viaje en una hoja de cálculo basada en un correo electrónico. Esta función, Preguntas y respuestas sobre datos, se implementará para los usuarios de Labs en julio.

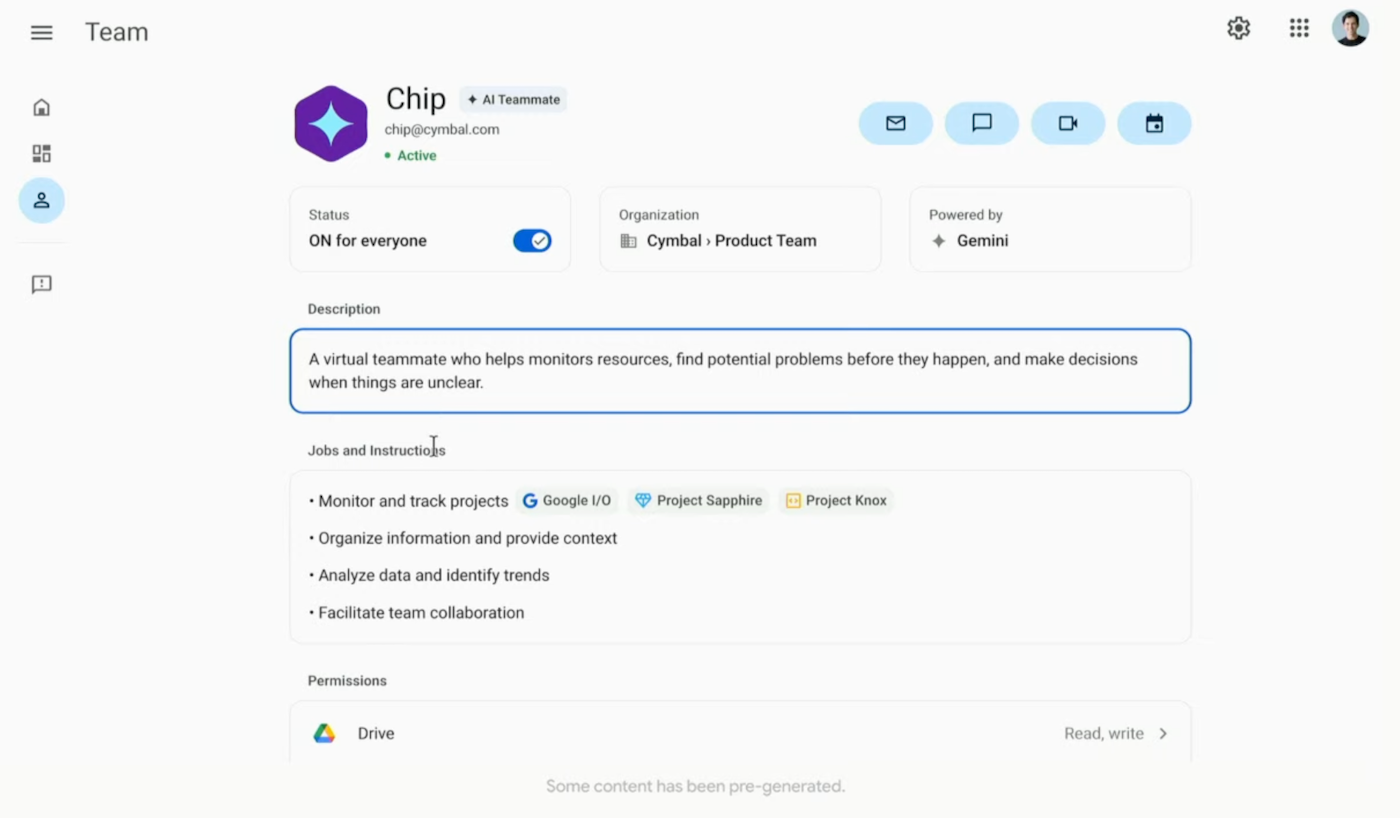

A continuación, Google quiere poder agregar un compañero de equipo virtual a Workspace. El Virtual Teammate actuará como un compañero de trabajo de IA, con una identidad, una cuenta de Workspace y un objetivo. (Pero sin necesidad de PTO). Los empleados pueden hacer preguntas sobre el trabajo al asistente, y el asistente mantendrá la “memoria colectiva” del equipo con el que trabaja.

Google aún no ha anunciado una fecha de lanzamiento para Virtual Teammate. Planean agregarle capacidades de terceros en el futuro. Esto es sólo especulativo, pero Virtual Teammate podría ser especialmente útil para las empresas si se conecta a aplicaciones CRM.

Las capacidades de voz y video llegarán a la aplicación Gemini

Las funciones de conversación y vídeo llegarán a la aplicación Gemini a finales de este año. Géminis podrá “ver” a través de su cámara y responder en tiempo real.

Los usuarios podrán crear “Gemas”, agentes personalizados para hacer cosas como actuar como entrenadores personales de escritura. La idea es hacer de Géminis “un verdadero asistente” que pueda, por ejemplo, planificar un viaje. Las gemas llegarán a Gemini Advanced este verano.

La incorporación de la multimodalidad a Gemini llega en un momento interesante en comparación con la demostración de ChatGPT con GPT-4o a principios de esta semana. Ambos mostraron una conversación que sonaba muy natural. La voz de IA de OpenAI respondió a la interrupción, pero leyó o interpretó mal algunas situaciones.

VER: OpenAI mostró cómo la versión más reciente del modelo GPT-4 puede responder al video en vivo.

Imagen 3 mejora en la generación de texto

Google anunció Imagen 3, la próxima evolución de su IA de generación de imágenes. Imagen 3 pretende ser mejor en la representación de texto, lo que ha sido una debilidad importante para los generadores de imágenes de IA en el pasado. Los creadores seleccionados pueden probar Imagen 3 en ImageFX en Google Labs hoy, e Imagine 3 llegará pronto para desarrolladores en Vertex AI.

Google y DeepMind revelan otras herramientas creativas de IA

Otro producto creativo de IA que anunció Google fue Veo, su modelo de vídeo generativo de próxima generación de DeepMind. Veo creó un vídeo impresionante de un automóvil atravesando un túnel y llegando a una calle de la ciudad. Veo puede ser utilizado por creadores selectos en VideoFX, una herramienta experimental que se encuentra en labs.google.

Es posible que otros tipos creativos quieran utilizar Music AI Sandbox, un conjunto de herramientas de inteligencia artificial generativa para hacer música. No se han anunciado fechas de lanzamiento públicas ni privadas para Music AI Sandbox.

Las GPU Trillium de sexta generación aumentan el poder de los centros de datos de Google Cloud

Pichai presentó las TPU Google Cloud de sexta generación de Google, llamadas Trillium. Google afirma que los TPU muestran una mejora de 4,7 veces con respecto a la generación anterior. Los TPU Trillium están destinados a agregar un mayor rendimiento a los centros de datos de Google Cloud y competir con los aceleradores de inteligencia artificial de NVIDIA. Time on Trillium estará disponible para los clientes de Google Cloud a finales de 2024. Además, las GPU Blackwell de NVIDIA estarán disponibles en Google Cloud a partir de 2025.

TechRepublic cubrió Google I/O de forma remota.